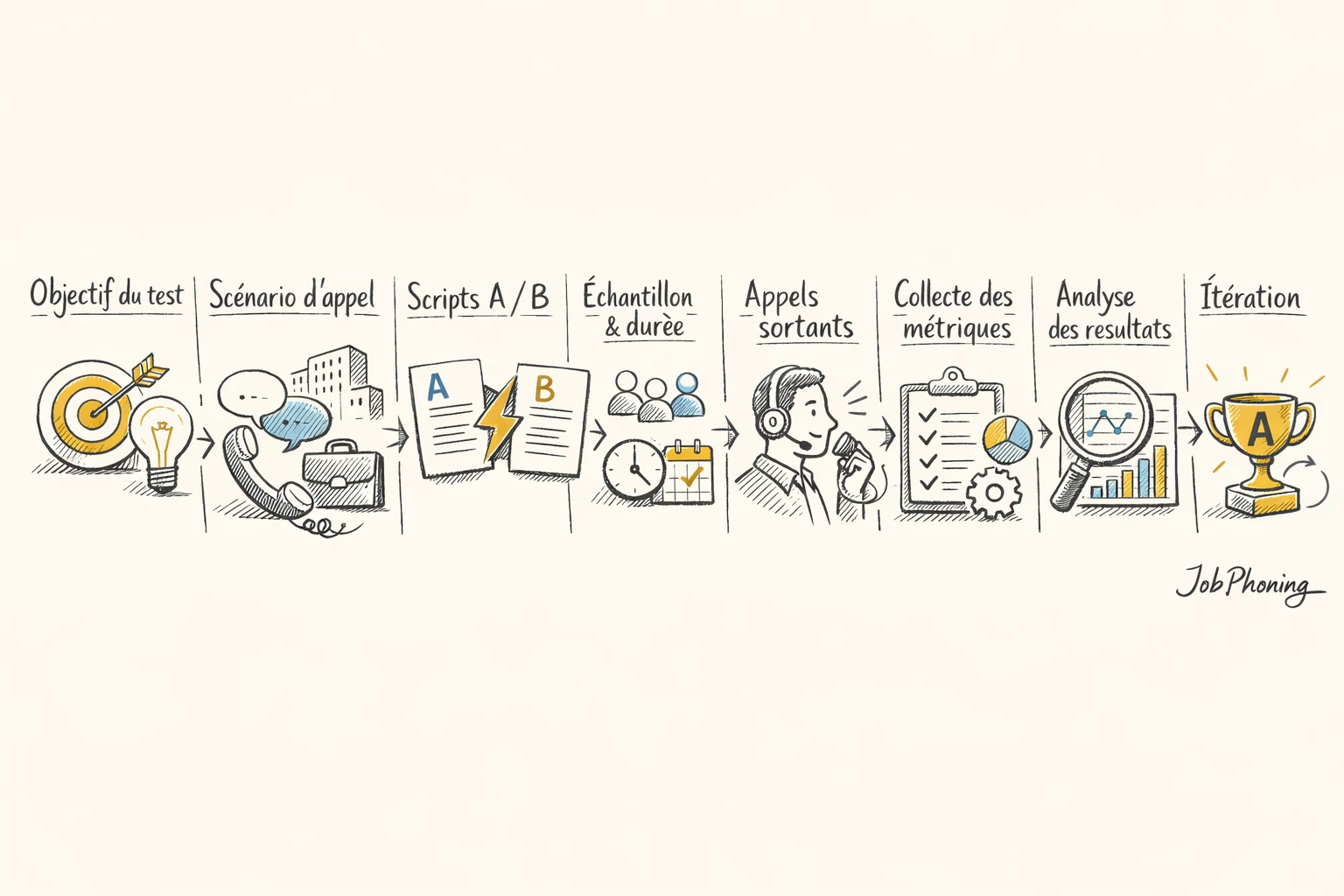

Optimiser vos appels de vente ne relève pas d’un « bon feeling », mais de la capacité à comparer objectivement plusieurs versions de votre discours. Ce contenu s’adresse aux directions commerciales, dirigeants de PME B2B et responsables marketing qui pilotent des équipes au téléphone, qu’elles soient internes ou appuyées par une plateforme comme JobPhoning. Imaginez un service commercial qui réalise déjà plusieurs centaines d’appels par semaine : les équipes travaillent, mais peu de décideurs acceptent d’aller plus loin. En structurant de véritables tests A/B sur vos scripts d’appel (accroche, enchaînement des arguments, formulation de la question finale), vous pouvez mesurer l’impact réel de chaque variante et ajuster vos choix sur des données fiables. Un simple gain de 1 à 2 points de taux de conversion sur les rendez-vous pris peut alors peser fortement sur le chiffre d’affaires, sans augmenter la pression sur les équipes.

Profitez de 15j d’essai gratuit sur notre logiciel de téléprospection